Razer lo tiene claro: el mercado de los videojuegos va camino de los 206.500 millones de dólares para 2028, y con casi cuatro mil millones de jugadores en el mundo, los estudios ya no pueden permitirse procesos de desarrollo lentos y deben apostar por apoyarse en la IA como palanca de desarrollo.

En el marco del Festival of Gaming de la GDC 2026, la marca de las tres serpientes ha desplegado su artillería pesada bajo una premisa clara que su vicepresidente de Software, Quyen Quach, resume en una frase «La IA debería potenciar la creatividad humana, no reemplazarla«. Como dice Quach, el objetivo debe ser que los desarrolladores recuperen el control y pasen de la idea a la ejecución con mayor rapidez, al tiempo que ofrecen ofrecer experiencias más ricas y atractivas. Para ello, la marca ha presentado tres pilares sobre los que fundamenta su propuesta: Razer AVA, Razer QA Companion-AI y Razer Adaptive Immersive Experience.

De asistente a «Agente»: El salto de Razer AVA

Muchos recordamos el Proyecto AVA de 2025 o aquel holograma 3D que vimos en el CES 2026. Pues bien, AVA finalmente ha madurado y ahora ya no es solo quiere ser un asistente reactivo con el que chatear, si no que quiere convertirse en tu asistente «agentic».

¿Qué pretender Razer con ello? Pues la idea es que ahora AVA entiende no solo ordenes, sino intenciones. Gracias a su nuevo plano de control de inferencia, AVA podría planificar y ejecutar tareas complejas, desde proponer una reunión y reservarla en el calendario hasta interactuar con Spotify o plataformas de chat de forma autónoma. Se acabó el configurar todo a mano, Razer quiere que AVA se encargue de lo cotidiano para que tú te centres en jugar o crear.

Principales capacidades clave de AVA:

- Impulsado por el nuevo plano de control de inferencia de Razer: Enruta las solicitudes de manera inteligente entre los modelos locales y en la nube para lograr una menor latencia, una continuidad más fluida de varios pasos y una ejecución eficiente a medida que las tareas se vuelven más complejas.

- Integración de aplicaciones y servicios de terceros: Capacidad de interactuar con servicios compatibles, plataformas de chat y aplicaciones como Spotify para actuar en nombre del usuario con reacciones complementarias en tiempo real.

- Flujos de trabajo de Agentic: Planifica y ejecuta tareas de varios pasos de forma autónoma, convirtiendo la intención en finalización a través de herramientas conectadas.

- Coordinación entre compañeros: Permite la comunicación entre agentes para que los compañeros de AVA puedan coordinar tareas de extremo a extremo entre usuarios, lo que incluye proponer horarios de reuniones, reservar calendarios y confirmar horarios.

- Si quieres probarlo, la beta ya está abierta a registro en Razer Cortex, con los primeros accesos previstos para su llegada en el segundo trimestre de este año.

Razer QA Companion-AI

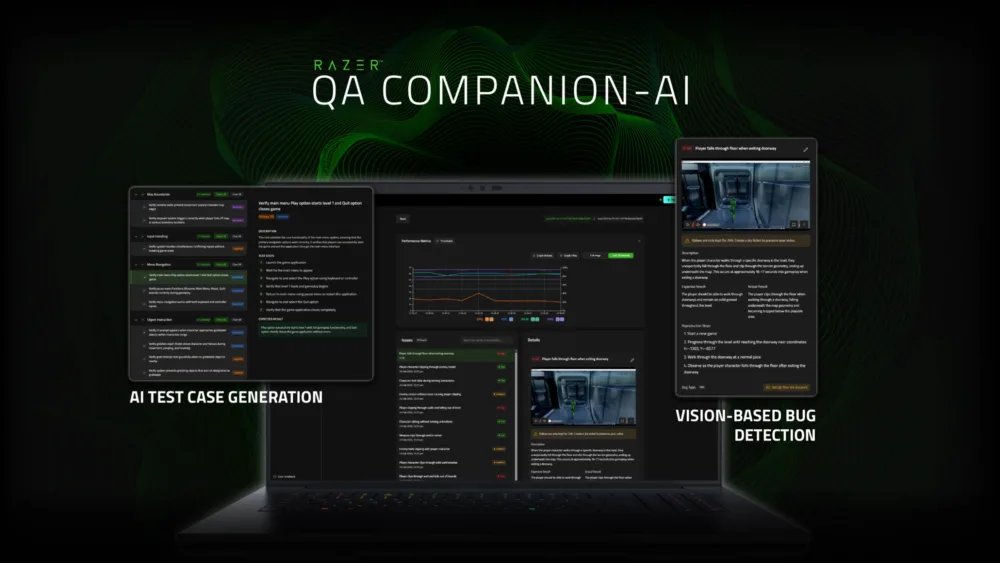

Si hay algo tedioso en el desarrollo de un juego es el control de calidad. Razer ha actualizado su Razer QA Companion-AI destacando que ahora se integra directamente en los flujos de trabajo de control de calidad existentes sin necesidad de SDK, plugins ni cambios de código

Este sistema es capaz de «ver» el juego, detectar fallos de colisiones o errores de renderizado y generar informes automáticos con vídeo y pasos para reproducir el error. Incluso han desarrollado agentes de IA que «juegan» por ti para probar casos límite. Una herramienta que promete acelerar los lanzamientos sin que la calidad se resienta por el camino.

Las mejoras clave incluyen:

- Implementación sin integración: Funciona de inmediato, sin necesidad de SDK, complementos ni cambios de código.

- Generación de casos de prueba de IA: Produce casos de prueba funcionales, negativos y de límites a partir de indicaciones del evaluador o entrada GDD opcional, generados en minutos y adaptables a distintos títulos.

- Detección de errores basada en visión: Toma imágenes del juego, identifica problemas visuales, incluida la física y las colisiones, la renderización y la animación, y genera informes de errores completos con pasos de reproducción y video.

- Agentes de juego de IA: Agentes autónomos que tienen en cuenta el juego y que ejecutan casos de prueba seleccionados, se adaptan a los cambios de diseño del juego y devuelven resúmenes de aprobación o desaprobación sin necesidad de scripts.

- Incorporación sencilla: Flujo simple con una instalación única de la aplicación puente, sin dependencias de software de terceros.

Inmersión multisensorial adaptativa

Razer ha presentado su tecnología Adaptive Immersive Experience, donde si antes integrar luces, háptica y audio espacial en un nuevo software era un trabajo pesado y complejo, ahora prometen que esto será un proceso que apenas llevará tres días, manteniendo la capacidad de ofrecer experiencias multisensoriales de alta calidad.

Lo interesante aquí es que el sistema es inteligente, utilizando el ecosistema WYVRN de Razer, Adaptive Immersive Experience, basado en la plataforma multisensorial de Razer Sensa HD Haptics, Chroma RGB y THX Spatial Audio+, para interpretar las señales de audio y visuales del juego en pantalla en tiempo real. Combina los efectos diseñados a mano por el estudio con una capa ambiental generada automáticamente. El resultado es una experiencia mucho más coherente y rica que se adapta a cada momento de la partida sin que el desarrollador tenga que programar cada pequeña acción.

Las capacidades clave incluyen:

- Efectos generados en tiempo real: La iluminación y las sensaciones ambientales adaptables se generan automáticamente mediante el tiempo de ejecución, lo que reduce la creación de scripts manuales y los ajustes de casos extremos, al tiempo que mantiene destacados los efectos creados.

- Biblioteca de efectos plug-and-play: Una biblioteca lista para producción de efectos hápticos y Chroma, validada en títulos enviados y totalmente compatible con Unity y Unreal Engine.

- Integración nativa de Wwise: Integración directa de Sensa HD Haptics y THX Spatial Audio+ en flujos de trabajo de audio Wwise establecidos para una adopción perfecta.

Razer no solo está vendiendo periféricos, está construyendo la infraestructura sobre la que se jugará mañana. Si estás por la GDC, las demos en vivo de AVA y el sistema de QA están dejando claro que 2026 es el año de la IA aplicada con sentido común.

Razer Adaptive Immersive Experience se implementará por fases a partir del primer trimestre de 2026, pero ya puedes conocer más en la web de Razer.